Gemini Robotics: Das sind die ersten Gemini-Roboter – bringen Googles KI-Modell jetzt in die reale Welt (Videos)

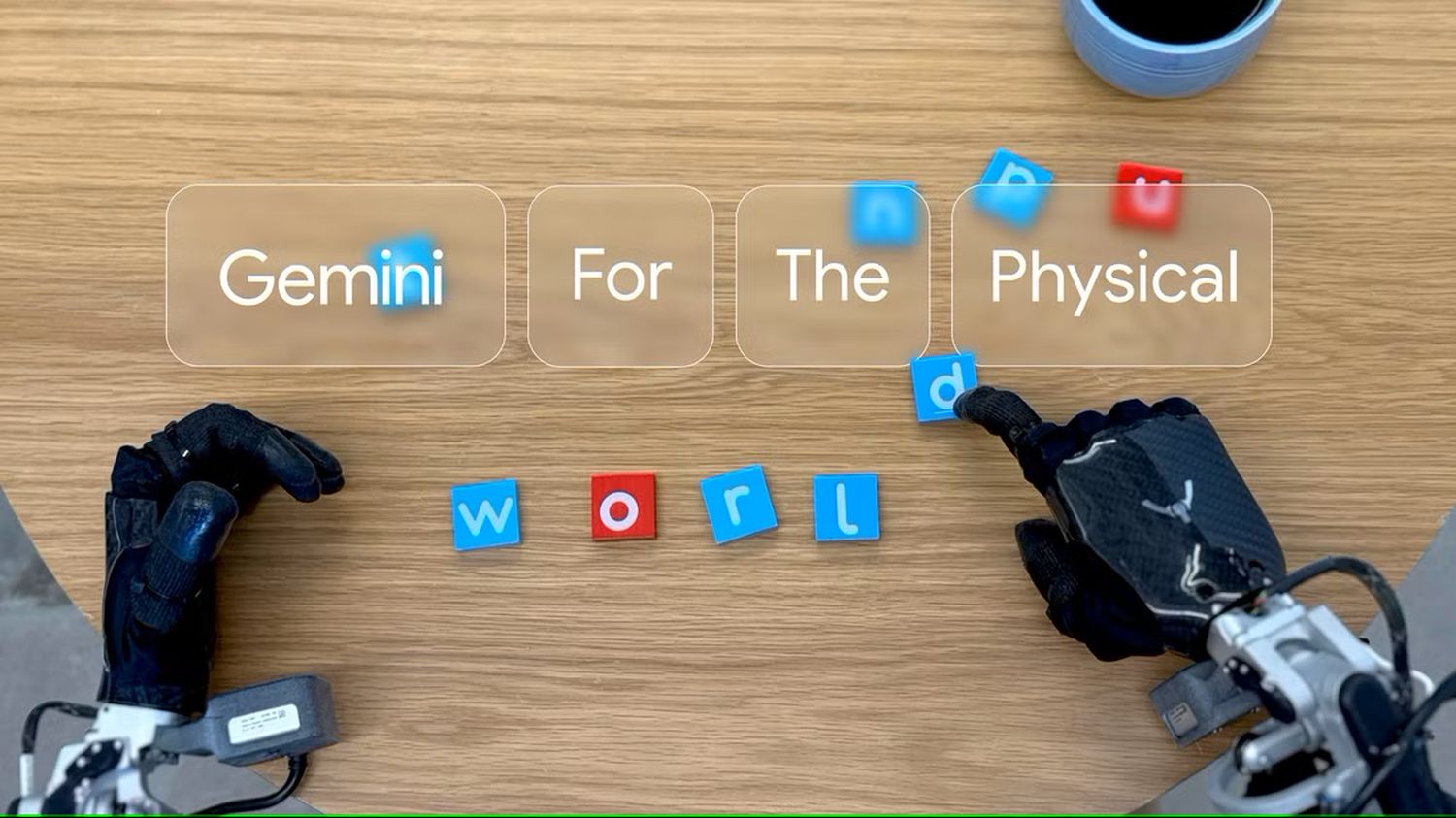

Google setzt das KI-Modell Gemini nicht nur für den gleichnamigen ChatBot ein, sondern dieses bildet auch die Grundlage für viele weitere Anwendungen. Jetzt steht der Schritt in die reale Welt an, denn Google hat vor wenigen Tagen die Plattform Gemini Robotics gezeigt und konnte innerhalb weniger Monate große Fortschritte machen. Wir zeigen euch, welche Möglichkeiten die von Gemini gesteuerten Roboter heute schon bieten.

Bei Google gibt es rund um das KI-Modell Gemini keine Grenzen mehr, denn dieses soll ein Stück weit aus seinen virtuellen Welten ausbrechen und auch auf Robotern zum Einsatz kommen. Wir haben euch erst vor wenigen Tagen ein Gemini für Roboter gezeigt, das lokal auf den Maschinen läuft und diesen eine vollständig autarke Steuerung ermöglicht. Dabei setzt man gleich für den ersten Testlauf auf einen Roboter in Menschen-ähnlicher Gestalt.

Im obigen Video ist zu sehen, wie der von Gemini gesteuerte Roboter ganz von selbst, nur auf Basis einer Anforderung durch den Menschen, einen Zauberwürfel in eine Tüte packt und im zweiten Teil des Videos eine Lunchbox mit Reißverschluss öffnet. Die Erkennung der Objekte, die Interaktion mit den Roboterhänden und deren Steuerung wird ausschließlich und ohne vorherige Programmierung von Gemini gesteuert. In einer etwas kontrollierteren Labor-Umgebung kann Gemini noch mehr.

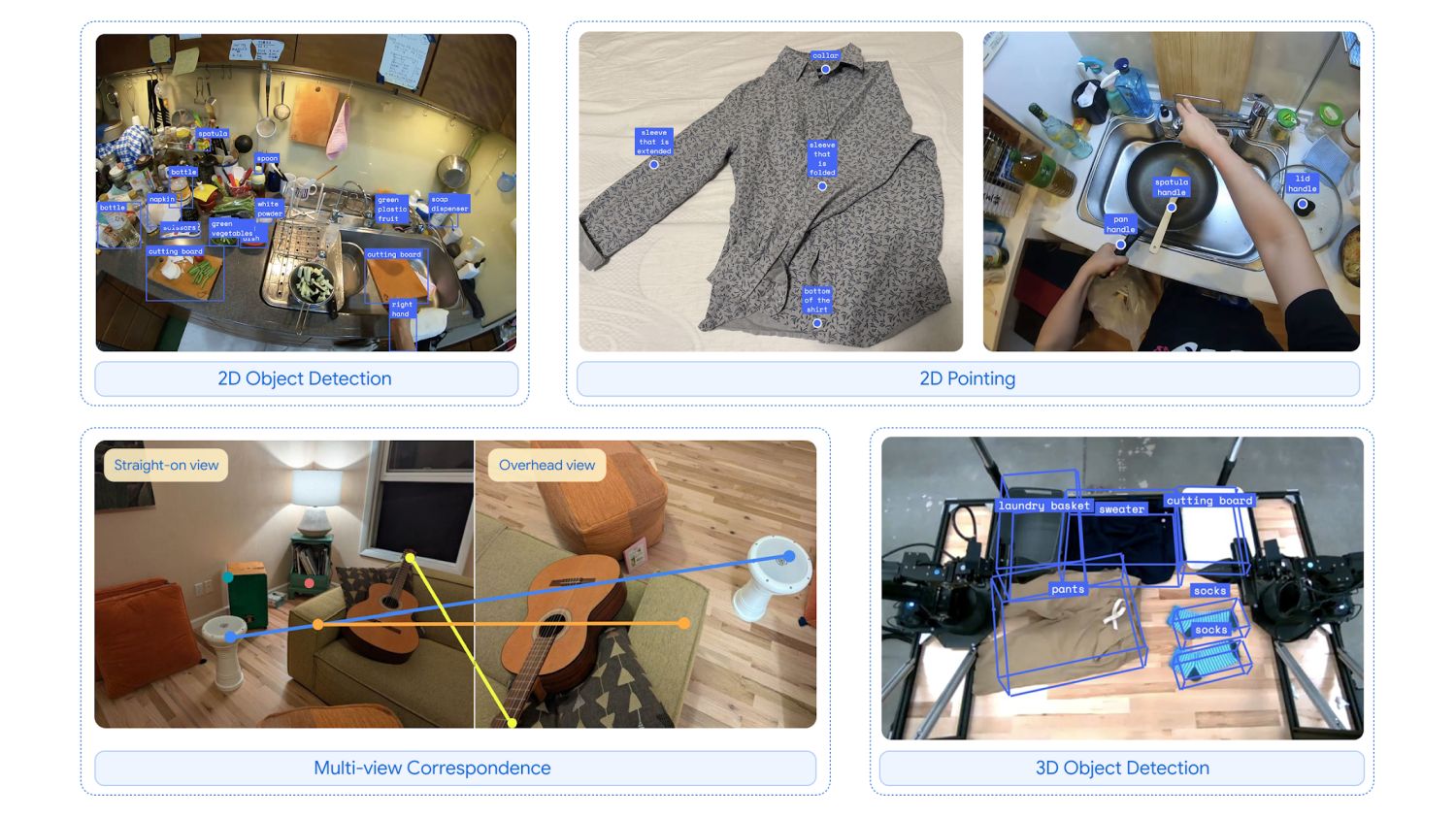

Gemini nimmt die Umgebung bzw. den Arbeitsbereich über die Kameras wahr, erkennt Objekte, deren Abmessungen und kann das Ganze in eine 3D-Welt mit den technisch benötigten Koordinaten umwandeln. Im nächsten Schritt geht es dann darum, diese Daten zu verstehen, die vom Nutzer gestellte Aufgabe zu verstehen und das Ganze dann in manipulativer Form in die Tat umzusetzen. So kann Gemini mit den Roboter-Armen dann Objekte verschieben, sortieren, etwas würfeln, Dinge hochheben oder im anspruchsvollsten Fall sogar ein Origami falten. In den folgenden Videos könnt ihr euch das einmal ansehen.

Natürlich gibt es solche Demos schon seit vielen Jahren, doch heute sind sie auf einem ganz anderen Level. Die Tätigkeiten sind dieselben – den Unterschied macht die Steuerung. Damals ging es darum, dass die Komponenten der Roboter genauestens programmiert wurden und diese Bewegungen abspulen konnten. Heute geht es mehr darum, dass die Software – in diesem Fall Gemini – diese Aufgaben selbstständig ausführt. Inklusive vorheriger Analyse, um Lösungswege zu entwickeln. Damit wird es für die KI erstmals möglich, in der realen Welt einen physischen Einfluss zu nehmen.

Diese vollautomatisierten Umsetzungen sind ein wichtiger Schritt für Gemini, die KI und die Robotik. Objekte werden automatisiert erkannt, identifiziert, es werden Einzelschritte zur Bewältigung der Aufgabe konzipiert und die Arme entsprechend gesteuert. Dabei kommen die laut Google „meistentwickelten optischen Fähigkeiten bei einem KI-Modell“ zum Einsatz, die es den Robotern ermöglicht, noch mehr Real-World-Aufgaben zu lösen als je zuvor.

Interessanterweise arbeitet man jetzt mit dem Robotik-Unternehmen Boston Dynamics zusammen, das vor einigen Jahren noch unter dem Dach von Google war und verkauft wurde. Es ist zu erwarten, dass wir rund um die Google I/O mehr davon sehen werden.

Letzte Aktualisierung am 22.04.2026 / Bilder von der Amazon Product Advertising API / Affiliate Links, vielen Dank für eure Unterstützung! Als Amazon-Partner verdiene ich an qualifizierten Verkäufen.

GoogleWatchBlog bei Google News abonnieren | GoogleWatchBlog-Newsletter