Mehr Power für Gemini: Google stellt zwei neue TPU-Chips vor – die nächste Generation für Supercomputer

Google konzentriert sich bei der Weiterentwicklung von Gemini nicht nur auf den Softwarebereich, sondern schon seit langer Zeit – deutlich vor dem KI-Boom – auch auf Hardware. Mittlerweile bringt man seit zehn Jahren die eigene Tensor Processing Unit (TPU) auf den Markt und jetzt startet man in die achte Generation. Diese soll Gemini noch mehr Power verleihen und ist auch für den Supercomputer-Einsatz konzipiert.

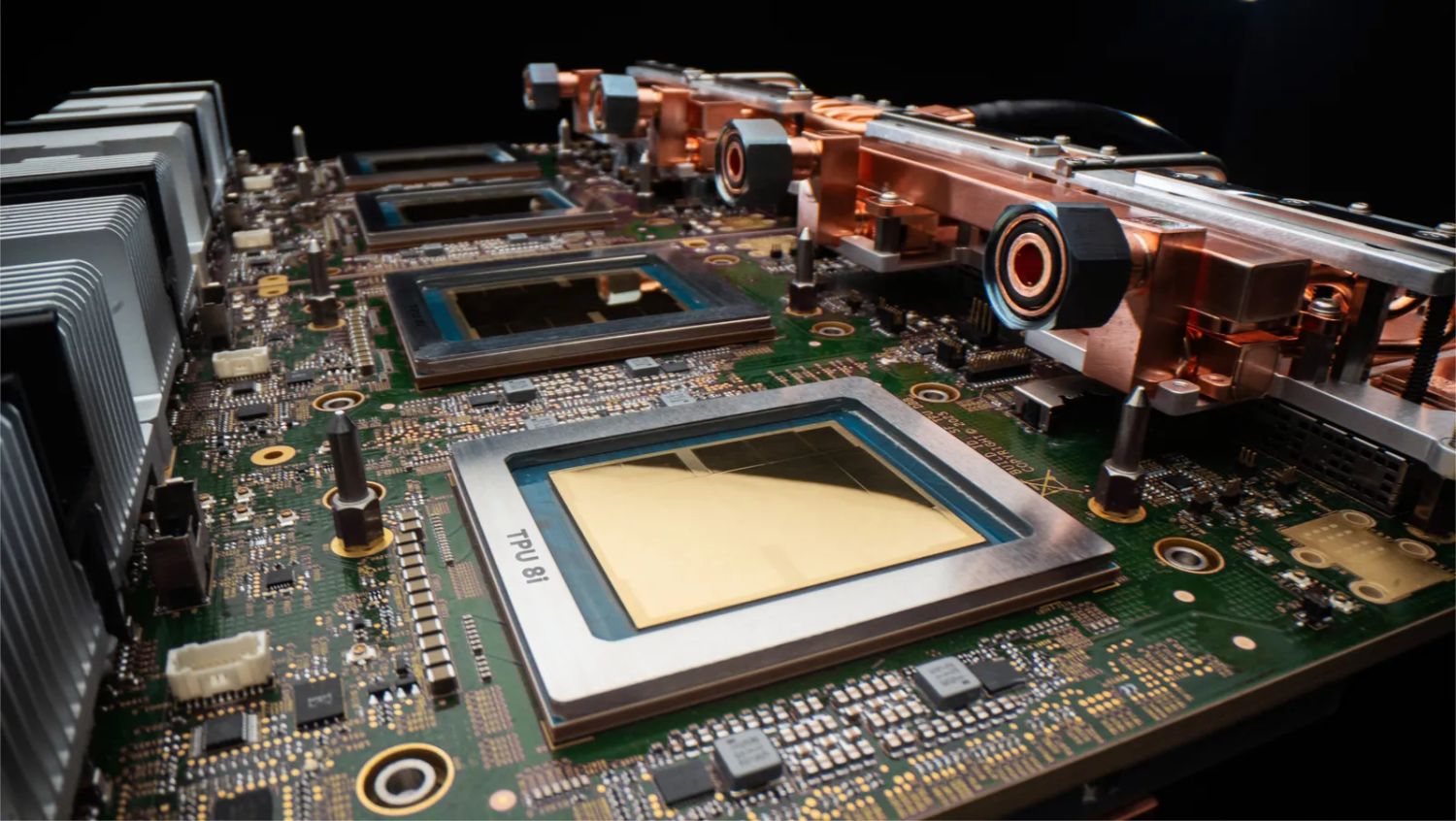

Mit dem TPU 8t und dem TPU 8i bringt Google zwei hochgradig angepasste Architekturen auf den Markt. Der TPU 8t fungiert dabei als leistungsstarkes System für das Training von KI-Modellen. Er ist darauf ausgelegt, gewaltige Datenmengen zu verarbeiten und die Entwicklungszeiten von sehr großen Modellen von Monaten auf wenige Wochen zu verkürzen. Der TPU 8i hingegen ist der Spezialist für die sogenannte „Inference“. Er kommt zum Einsatz, wenn die fertig trainierte KI live angewendet wird und blitzschnell auf Eingaben reagieren muss, wodurch flüssige Abläufe ohne spürbare Verzögerungen gewährleistet werden.

Ein wesentlicher Schwerpunkt dieser neuen Hardware ist die optimale Unterstützung von fortschrittlichen KI-Modellen wie Gemini. Die achte TPU-Generation wurde in direkter Zusammenarbeit mit Entwicklerteams konzipiert, um gezielt die enormen Anforderungen solcher komplexen Systeme zu erfüllen. Da Gemini große Informationsmengen auf einmal verarbeiten – etwa bei der Analyse langer Dokumente oder Videos – und vielschichtige logische Aufgaben bewältigen muss, liefert der speziell auf geringe Latenzen ausgelegte TPU 8i die exakt benötigte Speicherkapazität und Bandbreite. In der Praxis führt dies dazu, dass Gemini in der Lage ist, noch komplexere Problemstellungen effizient und ohne Leistungsabfälle zu bearbeiten.

Besonders beim Einsatz von sogenannten KI-Agenten wird dieser technologische Vorteil deutlich. Wenn eine umfangreiche Aufgabe an ein Modell wie Gemini übergeben wird, arbeiten im Hintergrund oft mehrere spezialisierte Agenten wie in einem Schwarm zusammen, um gemeinsam eine Lösung zu finden. Bisher entstand in Rechenzentren bei solchen verteilten Prozessen häufig ein Verzögerungseffekt, da Prozessoren untätig auf den Datenaustausch warten mussten. Die neuen Chips, die erstmals von Googles eigenen Arm-basierten Axion-Prozessoren angetrieben werden, minimieren diese Engpässe drastisch und ermöglichen eine nahezu verzögerungsfreie Kommunikation der Agenten untereinander.

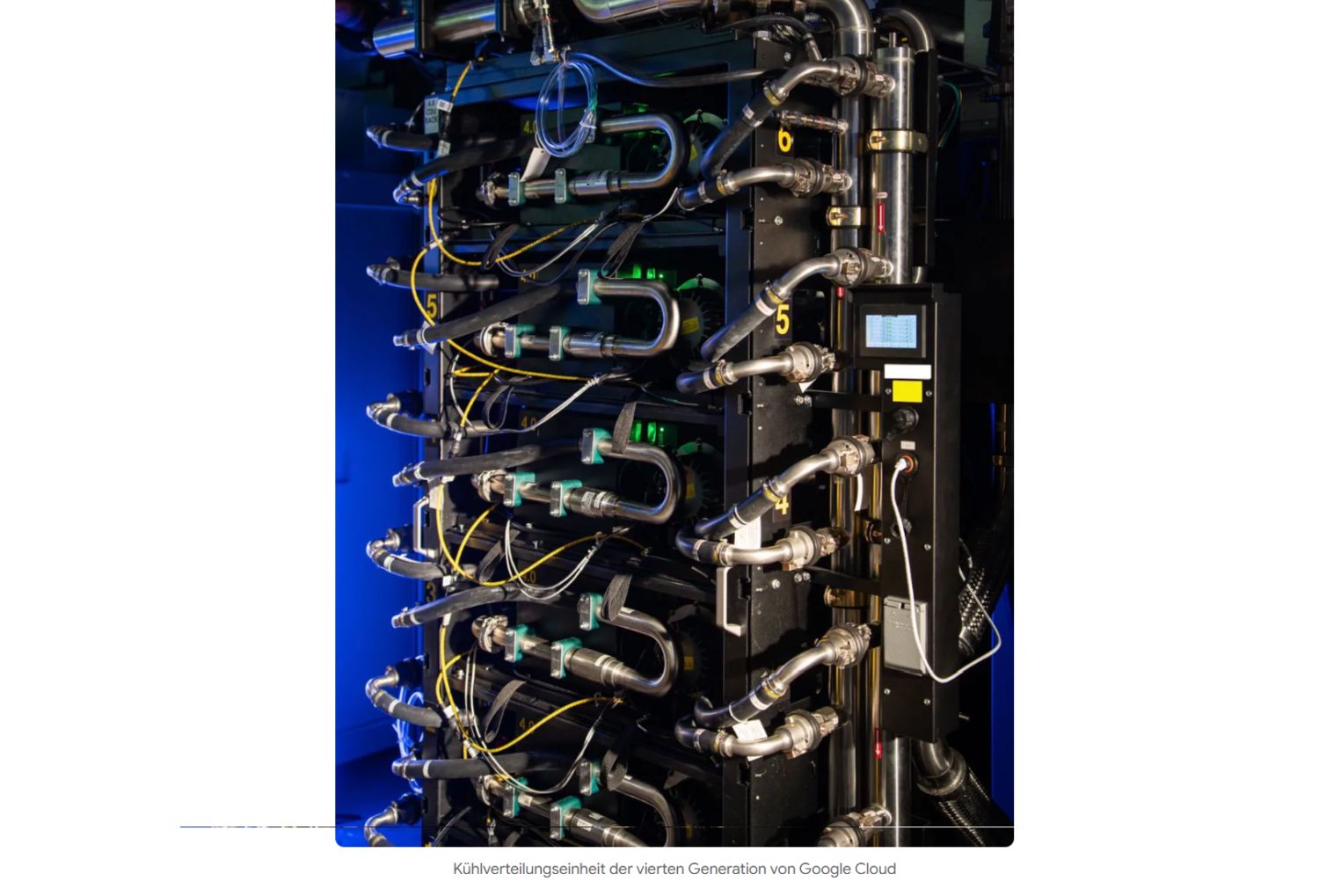

Neben der reinen Rechenleistung spielt auch die Energieeffizienz eine zentrale Rolle beim großflächigen Betrieb moderner KI-Systeme. Die Architektur der achten TPU-Generation wurde technisch dahingehend optimiert, dass sie bis zu doppelt so viel Leistung pro Watt liefert wie ihr Vorgänger. Durch den Einsatz einer fortschrittlichen Flüssigkeitskühlung der vierten Generation und eines integrierten Strommanagements, das sich dem Echtzeitbedarf der Prozessoren präzise anpasst, lässt sich der Energieverbrauch besser kontrollieren. Dies erhöht nicht nur die Wirtschaftlichkeit der Rechenzentren, sondern trägt auch zu einem ressourcenschonenderen Betrieb bei.

Insgesamt markieren die Modelle TPU 8t und TPU 8i einen bedeutenden technologischen Fortschritt in der grundlegenden Infrastruktur für Künstliche Intelligenz. Sie bilden das Fundament dafür, dass Modelle wie Gemini reaktionsschneller und bei komplexen Denkprozessen noch leistungsfähiger werden. Diese spezialisierte Supercomputer-Hardware schafft die nötigen Voraussetzungen für neuartige KI-Anwendungen, die zunehmend autonom agieren und anspruchsvolle Aufgabenstellungen in professionellen wie alltäglichen Anwendungsbereichen bewältigen können.

Letzte Aktualisierung am 30.05.2026 / Bilder von der Amazon Product Advertising API / Affiliate Links, vielen Dank für eure Unterstützung! Als Amazon-Partner verdiene ich an qualifizierten Verkäufen.

GoogleWatchBlog bei Google News abonnieren | GWB-Newsletter