Google Maps: So funktioniert die Augmented Reality-Navigation mit Googles neuer VPS-Technologie (Video)

In dieser Woche wurden die ersten Google Maps Local Guides mit einer neuen Augmented Reality-Navigation überrascht, an der das Google Maps-Team schon seit längerer Zeit arbeitet und nun für den ersten öffentlichen Testlauf bereit ist. Doch was wie ein zusätzliches Gimmick für die Navigation aussieht, hat ein riesiges Potenzial und eröffnet dank der dahinter stehenden Technologie viele neue Einsatzmöglichkeiten, wie Google nun in einem technischen Einblick selbst erklärt hat.

Die Google Maps Navigation wurde in den vergangenen Monaten sehr stark ausgebaut und mit vielen neuen Features ausgestattet, die sich endlich mal wieder um das Kerngeschäft der App drehten. Schon im Mai 2018 hatte das Team aber auch einen ersten Einblick in zukünftige Navigationsmöglichkeiten gegeben und diese in einem Video vorgestellt. Jetzt hat die erste großangelegte Testphase begonnen.

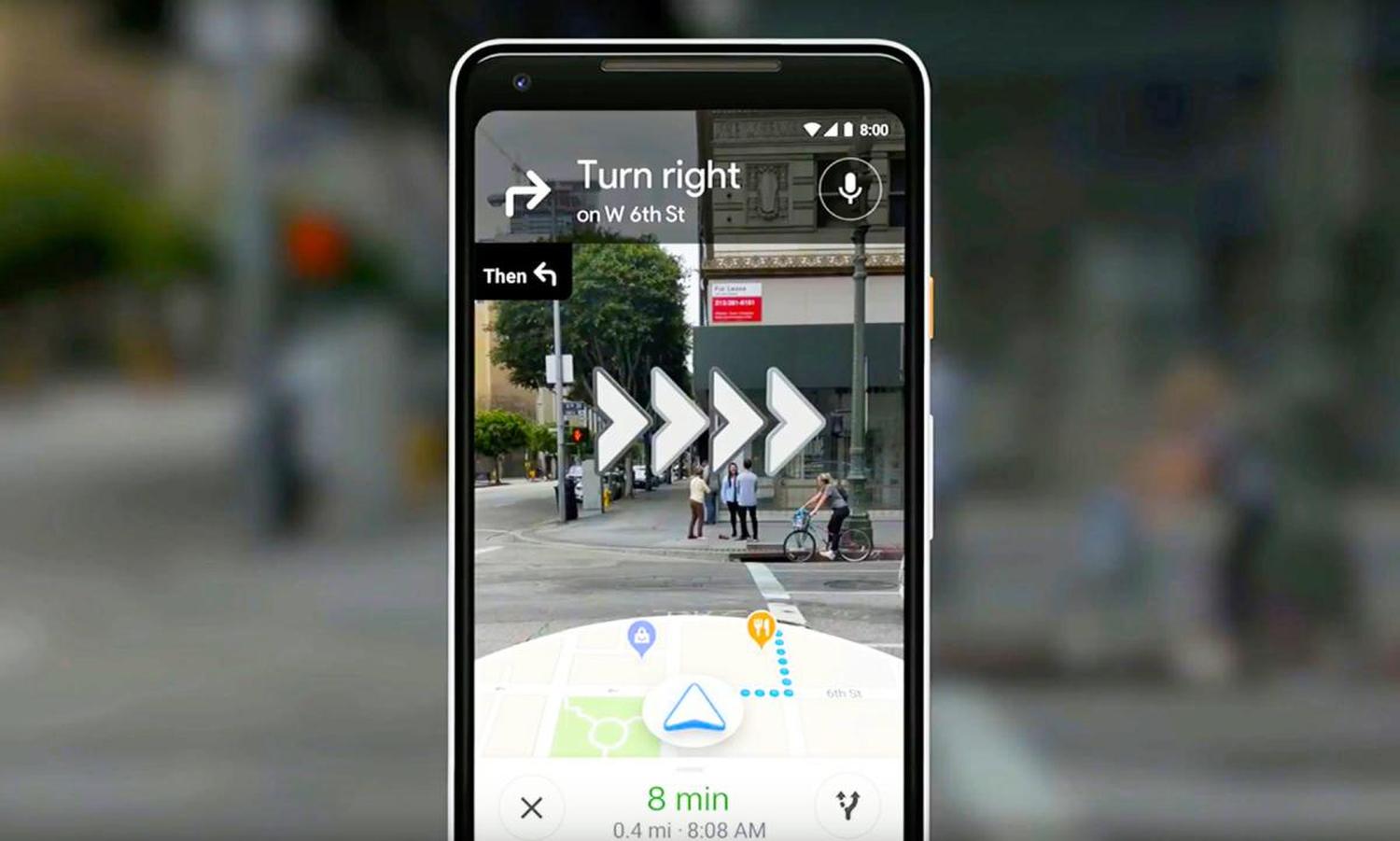

Das neue Feature nennt sich derzeit offiziell AR Navigation, also Augmented Reality-Navigation, und wird dieser Bezeichnung auch gerecht. Für die Navigation kommt das Kamerabild des Nutzers zum Einsatz, das von der Maps-Navigation analysiert und dann mit zusätzlichen Elementen versehen wird – was dann der eigentliche Einsatz der Augmented Reality ist. Wie das genau aussieht, seht ihr auf den Screenshots und Videos in diesem Artikel.

Diese Navigation fasst gleich mehrere Technologien zusammen: Grundlegend natürlich die starke Routenplanung von Google Maps, die gerade erst wieder prämiert wurde. Als Zweites kommt die Bilderkennung zum Einsatz und zuletzt noch die AR-Technologien, mit denen sich Objekte täuschend echt im Bild platzieren lassen und dabei sowohl Lage, Licht als auch Flächen und Hintergründe erkennen können. Ein gutes Beispiel dafür ist aktuell auch Googles neues Childish Gambino Playmoji.

Doch es ist auch noch eine weitere Technologie beteiligt, die als wichtiger Datenlieferant für dieses Feature fungiert: Streetview. Denn die daraus gewonnen Informationen sind für das Navigations-Team nun Gold wert.

Das Google Maps-Team hat nun einen interessanten Einblick in die VPS-Technologie (Visual Positioning Service) gegeben, die für die AR-Navigation essenziell ist. Die aktuell verbreiteten Technologien sind für die normale Navigation zwar ausreichend, haben aber ihre Grenzen und Tücken. GPS kann gerade in Großstädten auch mal meterweit daneben liegen und einen völlig falschen Standpunkt anzeigen, außerdem kann GPS lediglich die Position, aber nicht die Richtung orten. Dafür kommt dann der Kompass zum Einsatz, der aber ebenfalls leicht gestört werden und dann bis zu 180 Grad (!) daneben liegen kann.

Natürlich gibt es auch Ansätze über Schrittzähler, Beschleunigungssensoren oder die Bestimmung über WLAN-Triangulation, aber Google hat nun vor allem die Kamera als neuen Sensor entdeckt. Dabei geht es aber nicht um Objekterkennung, sondern eher um die Position von markanten Punkten. Aus dem Kamerabild werden automatisch „temporäre Objekte“ wie Menschen, Autos, Bäume oder auch Baugerüste herausgerechnet und anschließend nur markante Punkte von Gebäuden analysiert und vermessen.

Als Grundlage dienen die Bilder und Daten die die Streetview-Fahrzeuge in den letzten Jahre rund um die Welt gesammelt haben. Daraus hat sich Google Maps eine Datenbank von Billionen Datenpunkten aufgebaut und könnte wohl allein anhand dieser vielen Punkte viele Orte auf dieser Welt erkennen. In Kombination mit der ungefähren GPS-Position des Nutzers kann so eine exakte Standortbestimmung erfolgen – und genau diese braucht es. In obiger Animation ist das sehr gut zu sehen.

Damit das funktioniert, ist Google Maps natürlich auf aktuelle Streetview-Daten angewiesen, womit auch wieder einmal erklärt ist, warum die Streetview-Fahrzeuge in Deutschland unterwegs waren aber keine Bilder veröffentlicht worden sind. Es wurden lediglich alle Straßen und Gebäude sehr exakt vermessen. Da sich Gebäude vergleichsweise selten ändern und häufig auch mehrere markante Punkte als nur ein einziges Gebäude zu sehen sind, dürften aber auch mehrere Jahre alte Bilder exakte Ergebnisse liefern.

Derzeit testet Google Maps das Feature nun mit ausgesuchten Local Guides, die die Technologie nun in der Breite auf die Probe stellen. Unter idealen Bedingungen funktioniert so etwas sicherlich sehr gut, aber die sind eben gerade bei der Navigation im Freien nicht immer gegeben. Jetzt muss die Technologie zeigen, dass sie auch bei Regen, Schnee, Gewitter, Dunkelheit, Nebel oder auch einfach sehr vielen „temporären Hindernissen“ in der Lage ist, die Position des Nutzers zu erkennen.

Aufgrund dieser erweiterten Testphase kann das Google Maps-Team derzeit noch nicht sagen, wann dieses Feature für alle Nutzer ausgerollt wird. Bei Erfolg könnte es aber vielleicht schon in wenigen Monaten soweit sein. Doch die Navigation könnte nur der Anfang sein, denn mit diesen neuen Daten kann das Google Maps-Team mit Sicherheit noch viele weitere interessante Dinge anstellen, an die jetzt noch gar nicht zu denken ist. Mit Sicherheit dürfte die Erweiterung auf andere Navigations-Modi und Geräte ebenfalls auf der Agenda stehen.

» Ausführlicher Artikel im Google AI-Blog

Siehe auch

» ARCore 1.7: Google bringt Augmented Reality-Selfies & besser animierte Objekte auf die Smartphones

» Google Maps: Manipulationen verhindern – so lässt sich die Inhaberschaft eines Eintrags übernehmen

Google Maps: Augmented Reality-Navigation – der deutsche Streetview-Boykott rächt sich irgendwann

GoogleWatchBlog bei Google News abonnieren | GoogleWatchBlog-Newsletter

Ich finde die neue Funktion sehr Praktisch.

Ich darf die neue Funktion bereits Testen und bin durchweg begeistert

Mir wurde als local guide auch die Funktion angeboten. Beim Starten jedoch kommt die Meldung dass mein Gerät (Oneplus 3) keine Augmented Reality unterstützt