Google Suche demnächst mit Ranking nach Ladegeschwindigkeit

![]()

![]()

Bald wird die Google Suche auch nach dem Kriterium der Ladezeit sortieren. Das gab man heute auf dem Webmaster Blog bekannt. Zunächst nimmt die Ladegeschwindigkeit nur weniger als 1% der Gewichtung der Suchergebnisse ein, dennoch ist man bereit, in Zukunft auch schnellere Webseiten noch weiter zu bevorzugen.

Jetzt ist es quasi offiziell: Google wird demnächst Suchergebnisse nach der Ladezeit der Webseite gewichten. Mit einem Wert von weniger als 1% der rund 200 Suchkriterien möchte man schnellere Webseiten bevorzugen. Dies kommt dem Benutzer von Google zugute wie auch den Webseiten, die derzeit sehr schnell laden.

Dadurch ist es natürlich auch wiederum möglich, dass Webseiten, die aktuell sehr langsam laden, in den Hintergrund rücken und Benutzer verlieren. Dadurch aber auch andere Webseiten bevorzugt werden, die schnell laden und entsprechend wenige Benutzer haben.

Die Technik

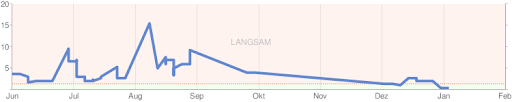

… ist nicht neu: In Google Webmaster-Tools wird derzeit überprüft, wie schnell die Webseite ist. Dies ist aber nur die Messung, welche der Googlebot ab Besuch bis zum entgütigen „letzten Byte“ der eigentlichen HTML-Ausgabe benötigt wird. Diese findet man unter „Diagnose“ -> „Crawling-Statistiken„. Der gute Wert liegt hier bei etwa 230 bis 500 Millisekunden.

Dennoch ist das nur die Ladezeit ohne Scripte, Stylesheets und ohne Bilder – eine reine HTML-Ausgabe, die auch vom Googlebot gemessen wird. Gemeint ist aber das Tool, welches sich derzeit unter Webmaster-Tools Labs befindet: „Webseiten-Leistung„. Diese Daten werden mit der Google Toolbar abgefragt und sind daher ziemlich eindeutig. Dabei wird die Leistung der Webseite mit ALLEN Scripts, CSS, Images, externen und internen Inhalten abgefragt und bewertet. Ein guter Wert liegt dabei bei etwa 0 bis 1,5 Sekunden. Jede zweite Webseite ist etwa 1 Sekunde schnell. Das heißt dass man über dem Durchschnitt liegt, wenn man unter einer Sekunde erreicht hat.

Nach ein „paar“ Tests seitens Google möchte man das Verfahren zunächst auf dem englischsprachigem Google.com testen, später aber auf alle anderen Locations ausrollen. Außerdem ist es möglich, dass die Ladezeit in Zukunft die Relevanz von Suchergebnissen weiter beeinflussen könnte.

Viele Tipps für Webmaster zum Thema Geschwindigkeit, Caching und Webseitengröße gibt es bei den Google Webmaster-Tools sowie im Blogeintrag.

GoogleWatchBlog bei Google News abonnieren | GWB-Newsletter

Finde ich gut das auch die Ladezeit einer Seite in Ranking einfliesen soll. Auch der Inhalt und die laufenden Veränderungen sollten besser bewertet werden.

Was nützt es, wenn eine Inhalts- und Bild-arme aber schnelle Seite bevorzugt wird.

Wenn Google das umsetzt fliegt bei mir als erstes Friendconnect raus und der Inhalt der Startseite wir auf mehrere Seiten verteilt.

-> Usability schlechter, Suchmaschinenposition besser.

Um an den selben Inhalt zu kommen muss man dann vier statt einer Seite laden.

@Google: Ist das im Sinne der Besucher?

i schätzte Google will damit hauptsächlich Druck auf langsame Seiten machen..

Dadurch werden vll manche Websitebetreiber irgendwelche nervigen, speicher-, CPu-Belastenden Flashanimationen rausmachen

ich finde es extrem nervig, wenn eine Seite ewigkeiten zum laden braucht

dann fliegt Analythics als erstes und Friendconnect als zweites raus.

Für mich stellt sich die Frage, wie lange die User Googles Alleingänge noch mit machen. Zum Glück bewerten die großen Werbeanbieter mittlerweile das Alexa-Ranking schon höher als das Pagerank von Google.

Die Geschichte hat oft genug gezeigt, das irgend wann die User nicht mehr mitziehen und andere Wege gehen.

Viele habe sehr viel Zeit und Geld in ihre Webseiten inverestiert, liefern interessante hilfreiche Inhalte ab. Das soll nun bestraft und die „Bildzeitung“ ähnlichen Seiten werden bevorzugt, dass muss man nicht verstehen.

Google bietet Analytics auch asynchron an und Analytics wird nicht mitgemessen, selbes gilt für AdSense.

Derzeit sind weniger als ein Ergebnis auf den ersten 10 Seiten.

@76361:

Ja finde ich auch, vor allem die nicht so viel Html-Kentnisse haben, müssen sich dann wohl nach Alternativen umschauen, wie anderes Design.

Hallo Pascal,

das ist dann doch die Wettbewerbsverzerrung in Reinkultur!!!

Wie oft hat man Wartezeiten das einem die Lust vergeht, weil Analythics nicht so richtig will, das spielt dann keine Rolle?

Alexa ist aber auch nicht das wahre.

Es ist wichtig, dass man so wenig wie möglich externe Bilder verwenden, da für diese erst jeweils die DNS geladen werden muss und das dauert. Außerdem Javascripte, css und co in eine packen, Statisches von Domains liefern, die keine Cookies setzen, bspw. Google Appengine als CDN nutzen, Bilder, css, js cachen lassen.

was sagt denn Page Speed zu eurer Rubrik Buttons in der Sidebar?

Das man sauberes CSS und JS verwendet, ist für jeden ordentlichen Webmaster selbstverständlich. Externe Bilder verwenden, ist doch immer schon ein Risiko.

Aber die Quintessenz ist doch folgendes, es trifft mal wieder die „Kleinen“, die sich keinen eigenen Server leisten können und häufig auch bei den Providern einen A….langsamen Webspace verwenden, was aber doch nichts über die Qualität des Angebotes aussagt. Ich bin in der glücklichen Lage einen eigenen schnellen Server zu haben, dass ändert jedoch nichts an meiner Meinung zu so einer Vorgehensweise.

Matt Cutts hat noch ein paar Details in seinem Blog und seiner Aussage nach betrifft diese Aenderung nahezu niemanden. Die Aenderung wurde auch schon vor einigen Wochen aktiviert und kaum jemand hats bemerkt.

http://www.mattcutts.com/blog/site-speed/

Vor dem Hintergrund kann ich die aufgeregte Diskussion hier in den Kommentaren nicht recht nachvollziehen.

@Smart-Max:

Warum sollte ein total professionelle Seite, die von Leute aufgesetzt wurde, denn einer bevorzugt werden, die von einem Anfänger aufgesetzt worden ist? Dann würde ja bedeuten, dass jemand, der keine Ahnung von Websites hat, auch gar nicht mehr in ein Top Ranking fällt. Ist ja grausam, dass es tatsächlich Menschen gibt, die professionelle Websites mit geprüfter und guter Software besser finden als die, die nicht funktionieren.

b2t:

Die 1% machen aktuell nicht viel aus, dass ist wohl mehr ein Test, nicht funktionierende Websites mit der Zeit rauszufiltern. Abgesehen davon gab es schon vor 10 Jahren Konventionen, die eine Ladezeit von 8 Sekunden als Höchstgrenze vorschreiben. Dass es wohl mittlerweile immer noch langsame Websites gibt, kann man im Jahr 2010 nicht nachvollziehen!

@Danny,

ich weiß zwar nicht was du in meine Aussage rein interpretierst, aber das verstehst du falsch.

Außerdem nehme ich an das es hier Meinungsfreiheit gibt.

@Kapet

vor diesem Hintergrund vielleicht, aber auch hier vor:

Ich habe einen Magento Shop. Google Labs zeigt eine Ladezeit von 4 sec an. Wobei die Ladezeit nur für die Startseite so hoch ist. (Danach ist das meiste im Chache)

Smart-Max: Das hier ist kein offizielles Google-Blog, was oben im Artikel steht wurde nicht durch Google veroeffentlicht und ich wuerde mich an deiner Stelle nicht darauf verlassen das alles bis ins letzte Detail stimmt.

Das ist ja ganz schön, wenn Google die Seitengeschwindigkeit als Ranking-Faktor verwendet. Wenn ich meine Seiten mit dem vom Google empfohlenen Tool „Pagespeed“ teste, dann ist alles okay – ausser Google Adsense, das gleich für vier Meldungen sorgt (Combine external Javascript, Minimize DNS lookups, Leverage browser caching, Leverage proxy caching). Vielleicht sollte Google da erst mal selbst Google Adsense optimieren, sonst sind dann bald alle Seiten, welche Adsense einsetzen, einem schlechteren Ranking unterworfen, was ja kaum im Sinne von Google sein kann.

Hallo Ana,

das wird ja nicht berücksichtigt. Wäre doch ganz schön blöde, wenn die Empfehlung lauten würde „entfernen sie Adsense“. 😀

Ich bin mal gespannt wie sich das neue Ranking-Kriterium auf traditionell langsamer ladende Seiten auswirkt. Ich denke da an Foto- und Videoseiten…