Project Soli: Google zeigt beeindruckende Radar-Technologie zur Objekterkennung [Video]

Noch vor der Umstrukturierung zu Alphabet hatte Googles ATAP-Abteilung (Advanced Technology And Projects) eine Reihe von Projekten gestartet und vorgestellt, die technologische Hürden überwinden und neue Möglichkeiten schaffen soll. Eines dieser Projekte war bzw. ist das Project Soli, das mit Radar-Technologie eine völlig neue Eingabemöglichkeit schaffen sollte. Jetzt hat sich das Team wieder zurück gemeldet und kann erstaunliche Fortschritte zeigen.

Bei der Vorstellung des Project Soli im Mai des vergangenen Jahres drehte sich das ganze vor allem noch um einen kleinen Chip, in den man eine erstaunlich kompakte Radar-Technologie packen konnte. Dieser Chip bzw. der Radar konnte die Finger des Nutzers registrieren und auch kleinste Bewegungen erkennen. Dadurch werden völlig neue Eingabemethoden möglich, ohne dass die Hardware oder ein Gegenstand tatsächlich berührt werden muss.

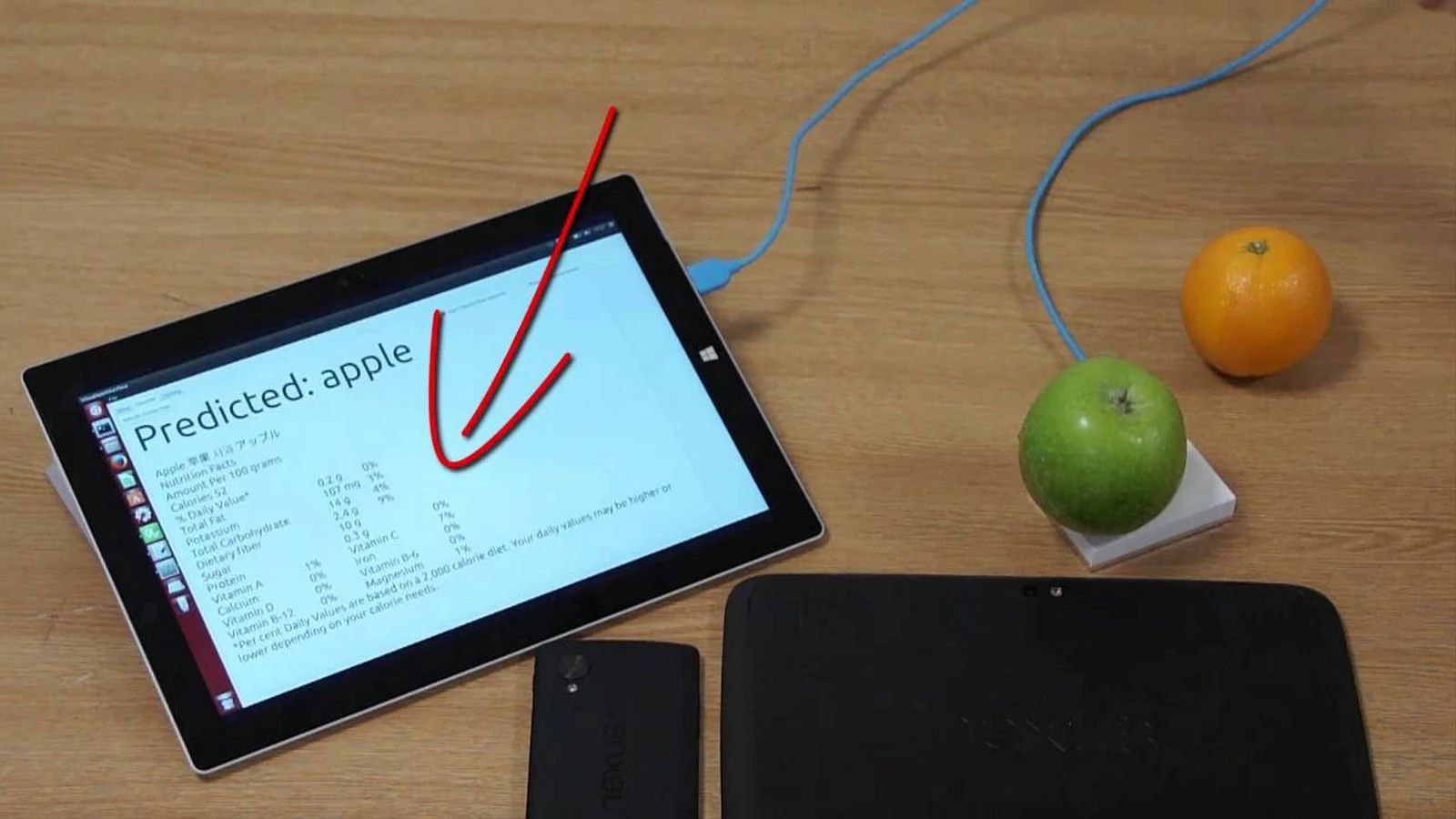

Doch „nur“ die Erschaffung einer neuen Eingabemethode war dem Soli-Team zu wenig, und so hat man mittlerweile erstaunliche Fortschritte machen und das Projekt in eine ganz andere Richtung drehen können. Soli besteht aktuell aus einem kleinen unscheinbaren Kasten, der aber sehr viel mehr leisten kann: Durch den integrierten Radar kann Soli Gegenstände sehr genau erkennen und auch benennen. Und das auch, obwohl deren Fläche möglicherweise sehr viel größer ist als der Kasten selbst.

Obiges Video demonstriert die Funktionsweise des neuen Soli-Projekts sehr gut. Der Kasten erkennt beispielsweise sofort wenn ein leeres Glas auf ihm abgestellt wird. Danach kann es auch problemlos erkennen ob sich nun Wasser oder Cola in dem Glas befindet bzw. ob es wieder leer ist. Aber auch die Erkennung von Äpfeln, einem Mousepad oder die genaue Zuordnung von Hardware ist für Soli kein Problem. Und das alles ohne auch nur eine verbaute Kamera oder andere Sensoren.

Durch mehrere Radars kann Soli von jedem Objekt einen Radar-Fingerabdruck erkennen und diesen mit einer Datenbank abgleichen. Das hat den Vorteil, dass das ganze später an eine Online-Datenbank angeschlossen werden kann, die von allen Nutzern mit immer mehr Daten gefüttert werden kann – und so könnte es eines Tages möglich sein, dass Soli jeden beliebigen Gegenstand erkennt. Aber auch verbaut in ein Smartphone kann Soli erkennen, an welcher Stelle des menschlichen Körpers es sich befindet.

Bisher hat Google noch kein konkretes Anwendungsgebiet für Soli genannt, aber die Möglichkeiten sind natürlich sehr vielfältig. So kann etwa im Restaurant automatisch nachbestellt werden, blinde und sehbehinderte könnten Soli um Hilfe bei der Erkennung fragen und eingebaut in ein Smartphone könnte diese Erkennung noch ganz andere Möglichkeiten eröffnen. Kombiniert man das ganze dann noch mit anderen Sensoren und Kameras, gibt es wohl kaum etwas dass Soli nicht erkennen kann.

Wirklich ein sehr spannendes Projekt!

GoogleWatchBlog bei Google News abonnieren | GoogleWatchBlog-Newsletter