Google Maps 3D: So funktioniert die schicke Immersive Routenplanung – Entwickler geben Einblicke (Videos)

Vor knapp einem Jahr hat das Team von Google Maps die 3D-Ansicht Immersive View angekündigt, die weit über die bisherigen Darstellungsformen hinausgeht. Aus der Kombination von Satellitenbildern, Streetview-Aufnahmen und vielleicht auch Nutzerfotos werden umfangreiche Modelle erstellt, die wiederum zu größeren Modellen zusammengeführt werden. Mit dieser Ansicht haben Nutzer unter anderem die Möglichkeit, eine geplante Route vorab in einer 3D-Ansicht „abzufliegen“ und zu erkunden. Jetzt haben die Ingenieure verraten, wie aufwendig und datenintensiv die Entwicklung gewesen ist.

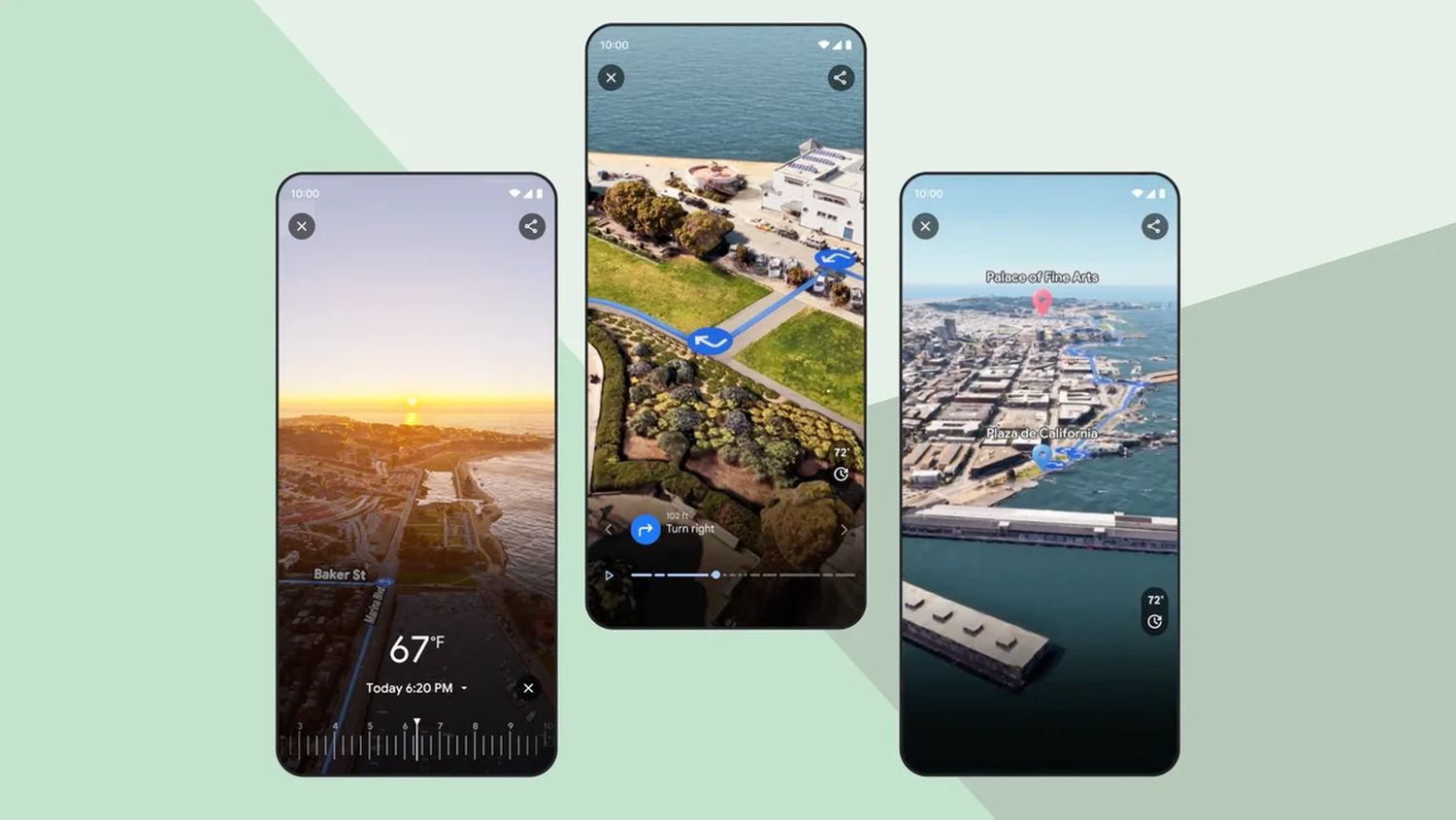

Mit den Immersive View-Ansichten hat Google Maps eine völlig neue 3D-Ansicht etabliert, die seit einiger Zeit für immer mehr Regionen ausgerollt wird und mit den Immersive View-Routen im Oktober die erste Erweiterung erhielt. Mit diesem Feature gibt man den Nutzern die Möglichkeit, die gesamte geplante Fahrstrecke in einer beeindruckend realistischen 3D-Ansicht zu erkunden und somit Details zu erkennen, die sonst weder auf der Karte, der Satellitenansicht oder in Streetview sichtbar wären. Denn Immersive View ist eine Kombination aus vielen verschiedenen Daten- und Bildquellen.

Im Google Maps-Blog wird ausführlich erklärt, wie das Ganze funktioniert. Weil die gesamte Umsetzung sehr technisch und hochkomplex ist, findet ihr hier nur eine Kurzfassung und könnt euch bei Interesse das englische Original im Google-Blog durchlesen. Ein kurzer Teaser verdeutlicht schon, dass es eine technische Herausforderung ist:

Zunächst werden Milliarden von hochauflösenden Bildern zusammengetragen. Diese Bilder werden dann in einem Prozess zusammengefügt: fast so, als würde man das größte Puzzle der Welt zusammensetzen.

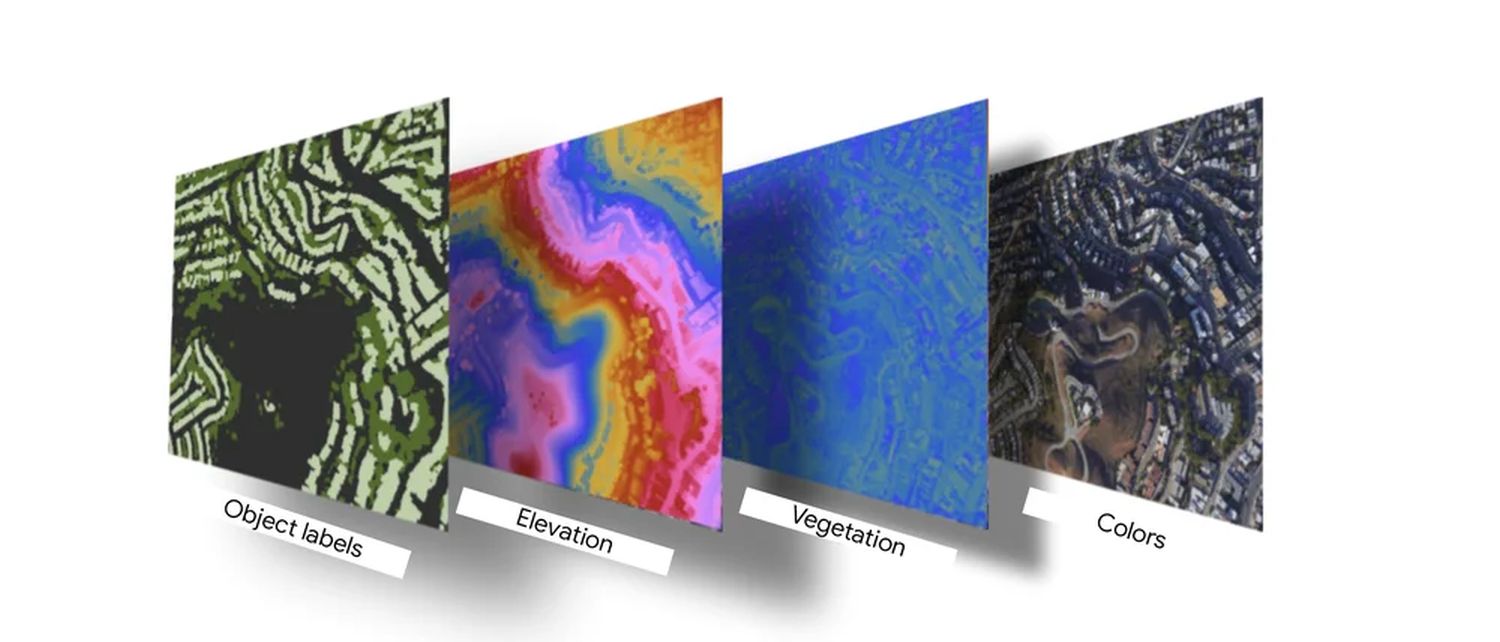

Den Grundstein für die Darstellung legen laut den Angaben aus dem Blog mehrere Milliarden Bilder aus den unterschiedlichsten Quellen, die zu einem 360 Grad-Layer zusammengefasst werden. Dabei können Satellitenbilder, Flugzeugfotos, Streetview-Aufnahmen und weitere Quellen zählen. Wie ihr auf der folgenden Grafik sehen könnt, gehört auch eine Höhenkarte dazu, um die grundlegende Darstellung von Gelände, Straßen und Gebäuden korrekt wiederzugeben.

Tatsächlich soll das Zusammenfügen wohl vergleichsweise einfach sein, denn das übernehmen über viele Jahre trainierte KI-Modelle, die man seit jeher auch für die Satellitenbilder oder Streetview-Fotos nutzt. Stattdessen liegen die Schwierigkeiten an einer ganz anderen Stelle: Denn das Bildmaterial muss exakt an das vorhandene Google Maps-Kartenmaterial angepasst werden. Und dabei reden wir nicht von einer groben Platzierung in Metern, sondern Zentimeter-genau. Ist das nicht der Fall, würde das bei einem 3D-Modell sofort auffallen.

Theoretisch klingt das recht simpel, aber mehrere Faktoren machen diesen Prozess recht komplex: Das gesamte Bildmaterial muss mit den vorhandenen Google Maps-Daten abgeglichen werden, damit alle Straßen, Wege und Geschäftsnamen zusammenpassen. Dies ist nur mit unseren fortschrittlichen Photogrammetrietechniken möglich, die Bilder und Daten auf den Zentimeter genau abgleichen können.

Möglich machen das selbstentwickelte Technologien, die Objekte, Straßenverläufe, Fahrzeuge, Verkehrsschilder und vieles mehr erkennen können, um diese mit den Google Maps-Kartendaten abzugleichen. Hat man das geschafft und diese 2D-Bilder an exakter Stelle auf die Karte gebracht, geht es damit weiter, die gesamten Medien in ein 3D-Modell umzurechnen. Denn das ist die Grundlage dafür, dass sowohl die Nutzer als auch die Routenplanungs-Algorithmen die Karte beliebig schwenken, drehen, kippen und anderweitig bewegen können.

Ist das 3D-Modell fertig, muss noch die Routenplanung ihre Arbeit verrichten, was wohl auch schwieriger ist, als man zuerst denken würde. Denn die auf der Karte platzierte blaue Linie für die Route muss exakt auf die Straßen gelegt werden. Diese ist demzufolge je nach Ansicht von Gebäuden, Bäumen oder auch Erhebungen verdeckt. Das sorgt dann erst dafür, dass die Darstellung realistisch wirkt.

Daten verarbeiten

Sobald wir die Bilddaten zusammengefügt haben, setzen wir KI und Computer Vision ein, um zu verstehen, was auf ihnen zu sehen ist. Innerhalb von Sekunden können unsere Modelle für maschinelles Lernen Elemente auf einem Foto erkennen – wie Gehwege, Straßenschilder, Schilder mit Geschwindigkeitsbegrenzungen, Straßennamen, Adressen, die angegebenen Öffnungszeiten und Gebäudeeingänge. Diese Modelle wurden anhand von Millionen von Fotos aus der ganzen Welt trainiert, so dass sie in der Lage sind, sich an verschiedene Regionen anzupassen und zu lernen. So können sie zum Beispiel ein „SLOW“-Schild in den USA erkennen, das eine gelbe oder orangefarbene Raute ist – und in Japan, das dreieckig und überwiegend weiß und rot ist.

Das Verständnis dieser Bildelemente hilft uns, euch die nützlichsten Informationen in Immersive View für Routen anzuzeigen. So könnt ihr euch zum Beispiel direkt zum Eingang eines Gebäudes navigieren lassen, was euch davor bewahrt, ein paar Runden um den Block zu drehen!

| # | Vorschau | Produkt | Preis | |

|---|---|---|---|---|

| 1 |

|

TomTom Pkw-Navi GO Classic 2nd (5 Zoll, Stauvermeidung Dank TomTom Traffic, Karten-Updates Europa... |

139,00 EUR

118,99 EUR |

Bei Amazon kaufen |

| 2 |

|

TomTom Pkw-Navi GO Classic Lite (6 Zoll, TomTom Traffic, Karten-Updates für Europa inklusive... |

139,00 EUR

122,82 EUR |

Bei Amazon kaufen |

| 3 |

|

TomTom Pkw-Navi GO Classic 2nd (6 Zoll, Stauvermeidung Dank TomTom Traffic, Karten-Updates Europa... |

159,00 EUR

147,97 EUR |

Bei Amazon kaufen |

| 4 |

|

7 Zoll Navigationsgeräte für Auto, GPS LKW Navigationsgeräte mit 2026 aktuellsten Europa Karten... | 64,99 EUR | Bei Amazon kaufen |

Letzte Aktualisierung am 22.04.2026 / Bilder von der Amazon Product Advertising API / Affiliate Links, vielen Dank für eure Unterstützung! Als Amazon-Partner verdiene ich an qualifizierten Verkäufen.

GoogleWatchBlog bei Google News abonnieren | GoogleWatchBlog-Newsletter