PlaNet: Google-Forscher entwickeln neurales Netzwerk, das den Aufnahmeort von Fotos bestimmen kann

Im Bereich der Fotoerkennung hat Google in den letzten Jahren enorme Fortschritte gemacht und kann mittlerweile sehr viele verschiedene Dinge, Personen und auch Szenen erkennen – wovon sich jeder selbst mit Google Photos überzeugen kann. Ein Team von Forschern hat sich nun aber eine sehr viel schwierigere Aufgabe gesetzt, mit der in den meisten Fällen auch ein Mensch überfordert ist: Die Erkennung des Standorts, an dem das Foto geschossen wurde – und das ohne Geo-Daten.

Die meisten Fotos im Netz sind mittlerweile mit Geo-Daten versehen, die vom Smartphone oder der Digitalkamera automatisch in den Meta-Daten speichert, und die dann wiederum von den diversen Online-Tools ausgewertet werden. Doch wenn diese Daten nicht zur Verfügung stehen, kann es in vielen Fällen auch für den Menschen sehr schwer werden, diese Fotos wieder zuzuordnen. Ein von Google-Forschern entwickeltes neurales Netzwerk soll dieses Kunststück nun vollautomatisch schaffen und konnte bereits sehr gute Achtungserfolge erzielen.

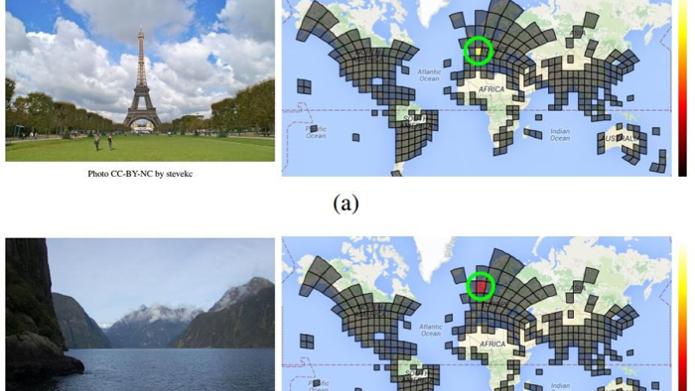

Innerhalb von Google gibt es eine Forschungsabteilung für „maschinelles Sehen“, die sich mit der Erkennung von Fotos beschäftigt. Diese hat nun ein neurales Netzwerk entwickelt, dass rein anhand eines Fotos erkennen soll, wo dieses aufgenommen wurde. Dazu wurde das System mit 91 Millionen Fotos gefüttert, die mit Geodaten versehen waren, so dass es die Welt und deren Gegebenheiten kennen lernen konnte. Zusätzlich hat man die gesamte Erde in 26.000 Quadrate eingeteilt, denen die einzelnen Fotos zugeordnet worden sind. In Gebieten mit vielen verfügbaren Fotos wurden diese Gebiete noch engmaschiger, in Gebieten mit sehr wenigen Fotos (Arktis, Zentralafrika) gibt es hingegen kaum Quadrate.

Nachdem das neurale Netzwerk mit den Daten gefüttert wurde, hat man diesem einen Testlauf unterzogen. Es wurde mit insgesamt 2,3 Millionen Fotos konfrontiert, die keinerlei Geo-Daten aufweisen und sollte diese dann zuordnen. Bei 3,6 Prozent aller Fotos konnte das Netzwerk diese straßengenau zuordnen, bei 10,1 Prozent wurde die richtige Stadt erkannt und bei fast jedem zweiten – 48 Prozent – wurde immerhin der richtige Kontinent getippt. Das ist um so mehr beeindruckender, als dass diese Werte deutlich über einem Menschen liegen – der Fotos und deren Hintergründe nicht so genau zuordnen kann.

Im Durchschnitt lag das von den Forschern auf die Bezeichnung „PlaNet“ getaufte Tool 1.131 Kilometer daneben. Menschen liegen im Durchschnitt ganze 2.320 Kilometer daneben, und liegen damit mehr als doppelt so hoch wie das Tool. Zwar hat der Mensch keine 91 Millionen „Vergleichsbilder“, doch auch die Intelligenz und die völlig andere Herangehensweise des Menschen konnte hier nicht punkten.

In Zukunft könnte diese Technologie etwa auch bei Google Photos zum Einsatz kommen, um ganze Alben ohne Geo-Informationen wieder mit den richtigen Daten zu versorgen. Wenn gleich mehrere Fotos zur Verfügung stehen steigt natürlich auch die Wahrscheinlichkeit der korrekten Erkennung.

Wer sich einmal selbst ausprobieren möchte, ob er den Wert des Netzwerks schlagen kann, kann das GeoGuessr-Spiel auch online spielen – und einfach das eingeblendete Foto auf der Weltkarte zuordnen. Dass das gar nicht so einfach ist, wird man schon bei den ersten Fotos merken.

[heise]

GoogleWatchBlog bei Google News abonnieren | GoogleWatchBlog-Newsletter

Auch wenn das nach Aussen hin als „neu“ definiert wird.Es erst bei Google Photos kommen soll, weiss ich aus eigener Erfahrung, dass Google dies vermutlich schon länger testet. Ich wohne in der Schweiz und hier war 2002 die sogenannte Expo02. Ich hatte zu der Zeit nur einen DigiFotoaparat ohne GPS! Doch als Google Photos an den Start ging, da habe ich natürlich alle Fotos zu dem Dienst hoch geladen und ich war erstaunt, dass die Fotos plötlich GPS Daten hatten, man sehen konnte wo diese Fotos aufgenommen wurden ! Das hat mich sehr geflasht! Vermutlich hatten andere mit GPS aufgenommen und auch hoch geladen und Google konnte so die Objekte erkennen und Fotos von anderen mit GPS Daten versehen. Vom selben Ereignis habe ich übrigens 360Grad Fotos in meinem Album. Doch damals konnte ich mit der Kamera gar keine 360Grad Fotos schiessen! Die müssen also irgendwie selbst von Google erzeugt worden sein.